Figure AI 推出了一种 端到端神经网络控制器,该控制器完全通过强化学习在模拟环境中训练,无需现实微调即可实现真实机器人的人类式行走。这是其“Embodied AI”路线图中的关键技术里程碑。

通过使用端到端的神经网络和强化学习(Reinforcement Learning, RL)技术,Figure 02 实现了更自然、更接近人类的步态。在短短几个小时内就完成了多年的数据模拟训练,这一进展被认为是人形机器人技术迈向实用化的重要里程碑。

- Figure 02 机器人现已能够以更平滑的步态和更高的速度行走,这一能力完全由强化学习驱动的神经网络实现。

- 与之前的 Figure 01(行走速度约为人类平均步速的 17%,即约 0.67 英里/小时)相比,Figure 02 的速度提升至 2.68 英里/小时(约 1.2 米/秒),是前代的七倍,接近人类正常行走速度(约 3-4 英里/小时)。

- 该技术采用“模拟到现实”(Sim-to-Real)的训练方式:首先在模拟环境中通过强化学习训练神经网络,随后将训练结果零样本(zero-shot)转移到真实机器人上,无需额外调整。

- 训练过程中,机器人通过反复试验和反馈学习如何调整步伐、保持平衡并适应不同地形,模仿人类行走的动态特性。

技术方法

1. 强化学习训练流程

- 训练环境:高保真物理引擎模拟器,运行在 GPU 加速系统上

- 并行模拟:成千上万的 Figure 02 机器人在不同物理条件下并行训练

- 训练效率:在几个小时内模拟出“数年”的行走数据

📌 训练策略:

- 使用强化学习(trial-and-error)

- 神经网络学习如何控制机器人行走

强化目标包括:

- 保持人类风格的步态

- 稳定性(抗干扰)

- 能效(低功耗)

- 精确跟踪目标速度

2. 注入“人类风格”的步态控制

Figure 并不满足于“能走”,更追求“像人一样走”。

我们人类走路的时候,其实是非常复杂的:

- 脚跟先落地(heel-strike)

- 脚尖再离地(toe-off)

- 手臂会自然摆动来保持平衡

- 面对不同地面,还会自动调整步态

Figure 训练的机器人也具备这些特征,因为他们在强化学习中:

✅ 给机器人加入了“模仿人类走路”的奖励机制

✅ 教它参考人类真实步态轨迹

✅ 同时还优化了:能耗更低、抗摔能力更强、不同地面也能适应

为此在训练中注入了以下设计:

- 引入 参考步态轨迹(human reference trajectories)作为训练目标

- 鼓励策略学习带脚跟落地(heel-strike)、脚尖离地(toe-off)、手臂自然摆动等典型人类步态

强化学习奖励函数同时兼顾:

- 模仿人类步态

- 节能

- 外部扰动(如推搡)下的鲁棒性

- 多种地形适应能力

3. Sim-to-Real Transfer:无缝从模拟转向实机部署

挑战:

- 模拟环境 ≠ 真实机器人系统(称为 sim-to-real gap)

Figure 的解决方案:

领域随机化(Domain Randomization):

- 在训练中对模拟机器人的物理参数(如摩擦、重量、动力系统)进行随机扰动

- 让策略具备广泛泛化能力

kHz 级扭矩反馈控制(High-rate torque feedback):

- 在实机运行中对神经网络输出加闭环控制

- 弥补模拟中的执行器建模误差

结果:

- 实现 “零样本迁移”(zero-shot transfer):无需微调,策略可直接在真机上运行

- 多台 Figure 02 机器人运行完全相同策略,无需个性化调整

- 显著缩短部署周期,具备规模化能力

系统能力展示与未来可扩展性

- 当前已有10台 Figure 02 机器人运行完全相同的策略,无需修改,步态稳定、一致

- 实现了真正的“类人行走”

- 支持抗干扰、复杂地形(如斜坡、障碍)等

这意味着 Figure 的强化学习方案具有大规模复制部署的潜力,未来可支持 成千上万的人形机器人量产部署

技术意义

📌 技术突破点:

- 强化学习驱动的人类风格机器人步态首次实现高质量 sim-to-real 零样本迁移

- 支持 端到端训练 + 高度可泛化策略 + 快速工程迭代,Figure AI 强调,其行走控制系统完全依赖端到端的神经网络,而非传统的基于规则的启发式方法。这种方法使机器人能够自适应地应对复杂任务,而无需人工编写具体规则。

- 神经网络同时运行于 Figure 的机器人集群中,确保所有机器人在同一套权重下协调工作。

📌 工程价值:

- 节省人工调参时间

- 消除手动设计控制器的复杂流程

- 提升部署速度与一致性

- 支持商业化机器人大规模应用部署

📌 Figure 的未来目标:

- 这一技术不仅限于行走,还为机器人执行更复杂的任务(如家务、工业操作)奠定了基础。自然步态的实现使 Figure 02 在家庭和工业环境中更具实用性。

- 公司表示,这一进展加速了其将人形机器人引入家庭的时间表,计划于 2025 年底开始“Alpha 测试”。

- 持续扩展策略适应范围,涵盖更多“人类真实环境”

- 实现机器人自主完成现实世界中的通用任务

- 借助 RL 和神经策略加速构建“具身智能代理”(Embodied AI agents)

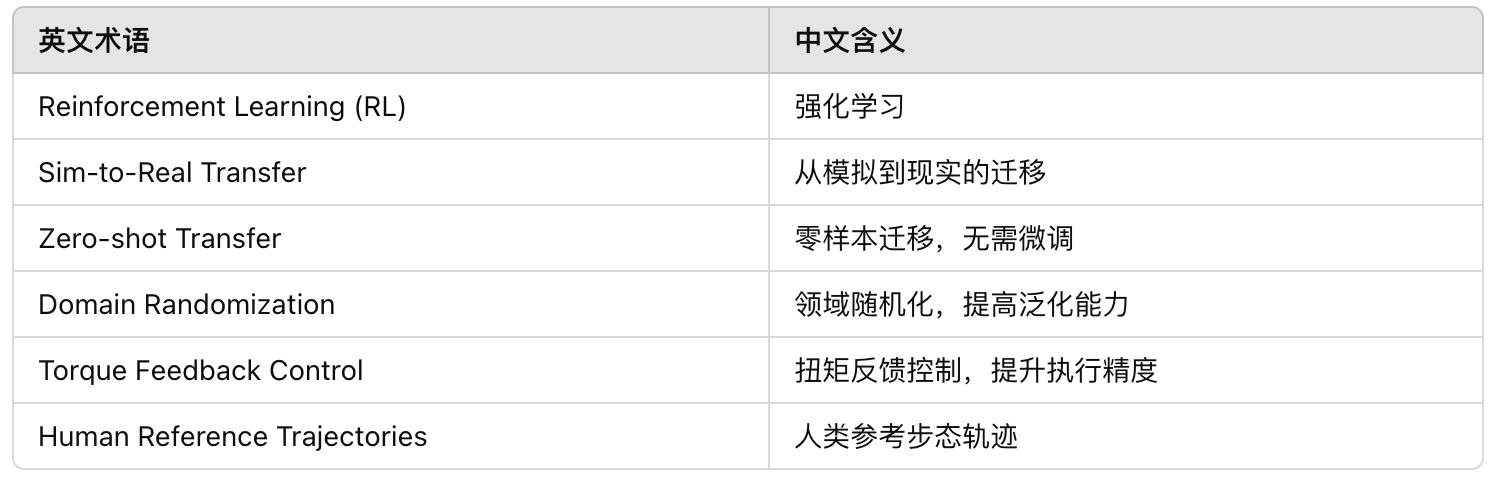

🖇️ 关键词对照表

官方介绍:https://www.figure.ai/news/reinforcement-learning-walking