ElevenLabs 推出了全新一代文本转语音模型 Eleven v3(Alpha 版),这是目前表现力最强的 TTS 模型之一,支持 70 多种语言、多个角色间的自然对话,以及通过 [sad]、[whispers]、[laughs] 等音频标签精准控制语音情绪与非语言表达。

与旧版本相比,v3 拥有更强的文本理解能力,可以模拟真实对话中的中断、情感变化与语气调整。这使得它非常适合用于视频创作、有声书制作和媒体工具开发。

特点:

- 支持 70+ 语言

- 支持 多角色对话

支持音频标签(如 [sad]、[laughs]、[whispers] 等)来控制情绪和表现力

v3 是研究预览版,需要更高水平的提示工程,但生成效果非常出色

- 新架构对文本理解更深,可实现更具表现力的语音

- 可模拟现实对话中的情感、打断、语气变化

- 即将开放 API 接口,支持创作者和开发者

🌟 V3主要升级亮点一览

✅ 1. 情绪+指令+音效 → 更拟真

v3 支持全新「音频标签(audio tags)」,开发者或创作者可以控制语音的:

- 情绪(愤怒、高兴、紧张、冷静等)

- 强调与语调走向

- 暂停、语速、音效混合(如“笑声”、“尖叫”)

🌈 例子:

你可以生成一段内容,从「小声嘟囔」过渡到「歇斯底里大笑」,再加入背景音效,让听者沉浸其中。

✅ 2. 多角色、交叉打断对话能力

- 支持 两个及以上角色进行自然互动;

- 支持同步语境和情绪匹配;

- 对话中可设置打断、抢话、幽默过场等;

- 模拟真实人类对话场景,比以往任何版本更流畅自然。

✅ 3. 语言覆盖:70+ 语言支持

相较于 v2 的 29 种语言,v3 现支持超过 70 种语言,覆盖:

- 所有主流语言(英文、中文、法语、西班牙语、阿拉伯语等)

- 地区小语种(僧伽罗语、吉尔吉斯语、乌尔都语等)

🎯 用途: 非英文播客、全球配音、本地化音频内容生成。

✅ 4. 文本到对话(Text to Dialogue)新模式

这是 v3 中最强大的能力之一:

- 通过普通文本,自动将不同角色、语气、音色编织成「对话音频」;

- 不需要逐句标记角色或语气,系统会自动判断;

- 生成的对话极具表现力与连贯性,适用于音频剧、游戏对白、广告创作等。

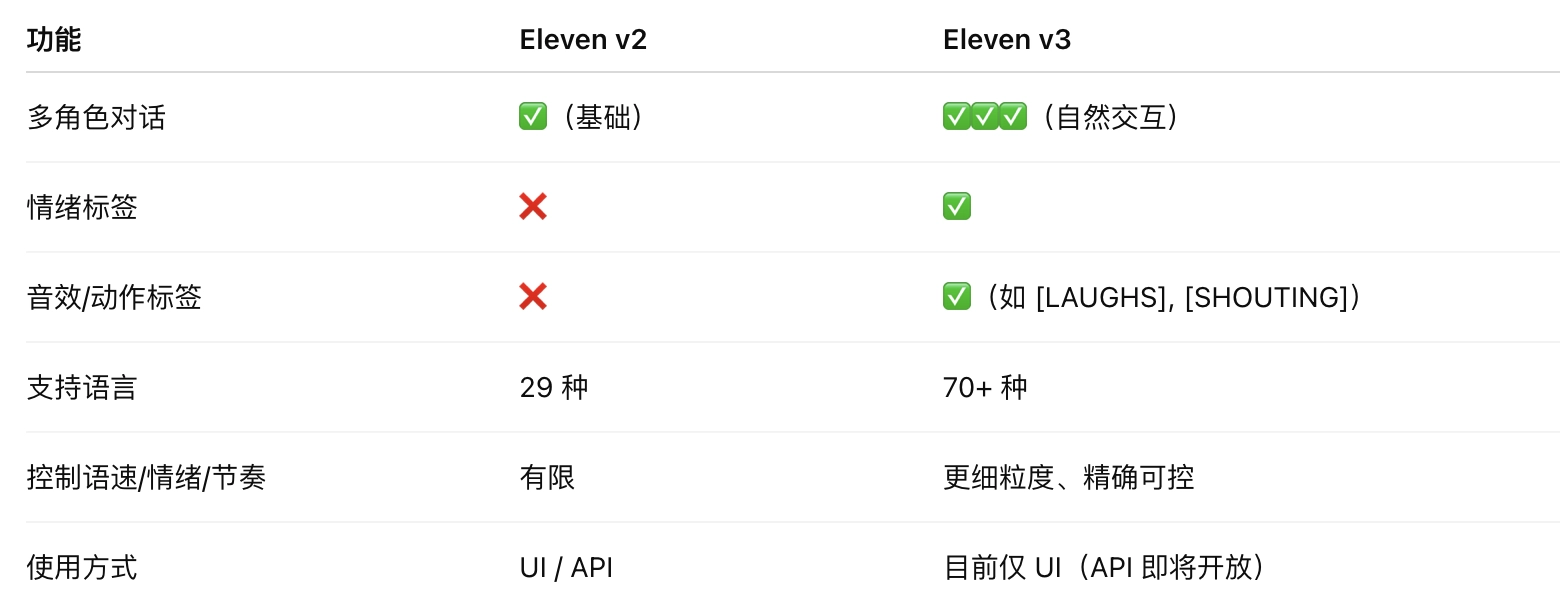

v2 与 v3 对比

支持哪些标签?

- 情绪类:[ANGRY], [LAUGHS], [WHISPERS]

- 动作类:[SHOUTING], [SIGHING]

- 音效类:[EVIL LAUGH], [GIGGLE]

详细标签参考:Prompting Guide 🔗