Google 在Google I/O 2025大会上 展示了原型版 Android XR 智能眼镜,同时宣布将其先进的 Gemini AI 模型深度整合至全新的 Android XR 平台,使其成为首个“为 Gemini 时代打造的 Android 平台”。

目标是通过头戴设备(如智能眼镜、AR/VR 头显等)提供自然、沉浸、实时的人工智能体验,使 AI 助手能“看见你所看”,理解场景,提供即时帮助。

Android XR 智能眼镜可以

- 上下文理解:通过摄像头和麦克风获取用户视角,结合地理位置信息理解当前场景和任务。

- 语音交互:随时启动语音助手,无需手动唤醒、无需使用手机。

- 实时辅助:根据用户行为自动推荐动作,如导航、查资料、拍照、翻译等。

- 记忆与个性化:具备长时间任务记忆功能,理解用户偏好、事务上下文。

- 与 Gemini 整合,实现真正的视觉助手

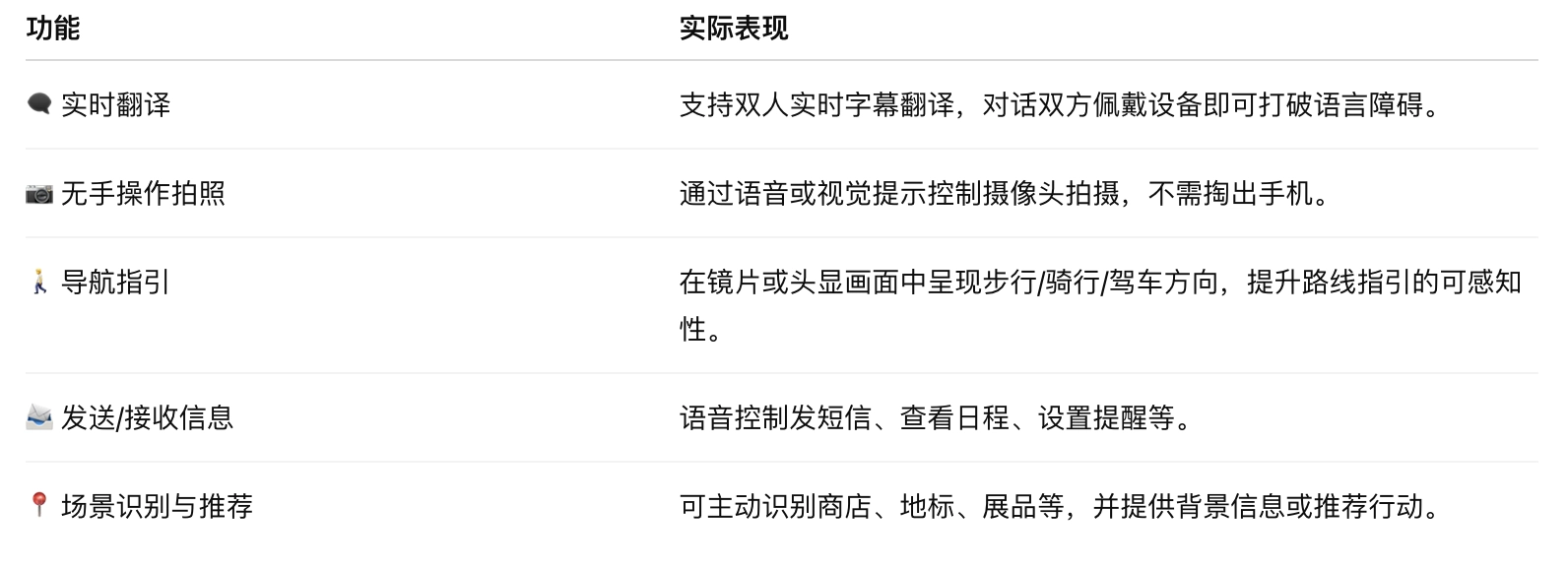

Google 在 I/O 大会展示了 Android XR 设备的现实使用场景,涵盖以下能力:

实时翻译

地图导航

实时获取信息和回复

拍照和视频

这标志着 Google 正走向“AI+硬件+操作系统”一体化平台。

✅ Gemini 将成为现实世界的智能层,不再局限于屏幕中。

Google 还披露了当前智能眼镜原型的关键硬件规格:

- 📷 摄像头:用于视觉识别、AR场景捕捉;

- 🎤 麦克风:接收语音命令并用于环境音处理;

- 🔊 扬声器:提供语音反馈、导航播报等;

- 🖼️ 镜片内信息显示(可选):在镜片上私密投射信息,非全息/AR 显示,但具备基本提醒与字幕功能;

- 📶 与手机协同工作:眼镜本身并非独立设备,通过蓝牙/Wi-Fi 与 Android 手机配对,实现数据处理与显示分离。

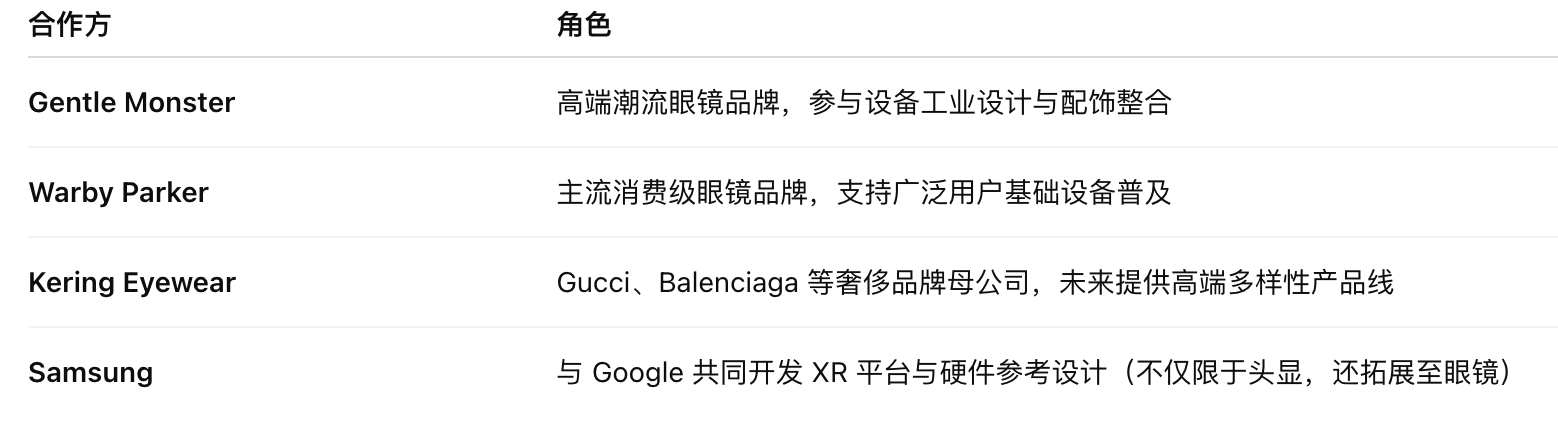

为确保眼镜具备时尚与日常佩戴性,Google 正与多个品牌展开合作: