Google 推出了一个融合 多种地理空间基础模型(Geospatial Foundation Models)+ 生成式 AI(如 Gemini)+ Agent 工作流 的研究框架Geospatial Reasoning ,目标是:

它能“将复杂、分散、异构的地理空间数据,快速转化为智能洞察与可视化决策支持。”

让 AI 自动理解、分析并回答跟“地理位置”相关的复杂问题,

比如哪里被洪水淹了?哪栋楼被风暴毁了?哪里的人口变化最大?哪里最该先救援?

Geospatial Reasoning :就像一个“地理 AI 大脑”系统,能把图像、地图、天气和语言理解结合起来,自动回答复杂的地理问题,帮你更聪明地做决策。

实际应用还包括:

公共卫生:了解疾病传播/优化干预措施。

气候适应力:风险建模/规划适应。

商业应用:增强物流、选址、需求预测。

🌍 什么是地理空间推理?

- 地理空间推理(Geospatial Reasoning)是利用 生成式 AI 与多个基础模型(Foundation Models),从复杂的地理空间数据中推导出有意义的洞察。

- 目标:加速城市管理、气候韧性、灾害响应、公共健康、商业规划等领域的分析效率与深度。

💡 挑战动因

- 地理空间数据庞杂、多模态(卫星图像、天气、人口、地图等),往往难以整合

- 数据稀疏,标注昂贵,传统 AI 不擅长空间数据处理

- 需要同时解决数据融合、自然语言问答、可解释分析等问题

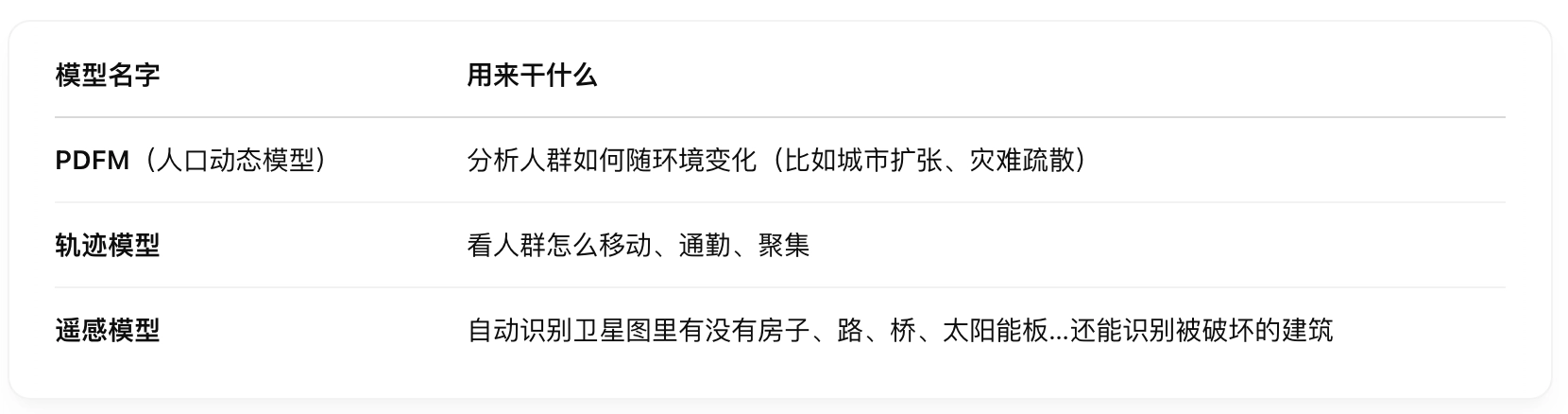

✅ 集成多种“基础模型”(Foundation Models)

就像人类会用地图、卫星图、天气信息做判断,AI 也要学会理解这些数据,所以 Google 训练了三种强大的模型:

✅ PDFM:人口动态基础模型

- 建模人群行为与环境的复杂关系

- 已在美国应用,正在扩展至英国、澳大利亚、日本、加拿大、马拉维等国

- 用途:城市发展、健康传播模拟、公共安全等

✅ 轨迹基础模型(Trajectory-based Mobility Model)

- 追踪人类移动轨迹(如出行模式)

- 用于交通建模、疫情预测、物流优化

✅ 遥感基础模型(Remote Sensing Foundation Models)

- 基于高分辨率卫星/航拍图训练

- 应用于建筑识别、道路提取、洪灾损毁评估等

模型架构包含:

- Masked Autoencoders(MAE)

- SigLIP(视觉文本嵌入)

- MaMMUT:多模态理解

- OWL-ViT:零样本图像检测

所有模型支持 自然语言查询、零样本分类、跨模态对齐。

这些模型可以理解图像、文字,也能“听懂”自然语言问题,比如:

“找到那些装了太阳能板的居民区”

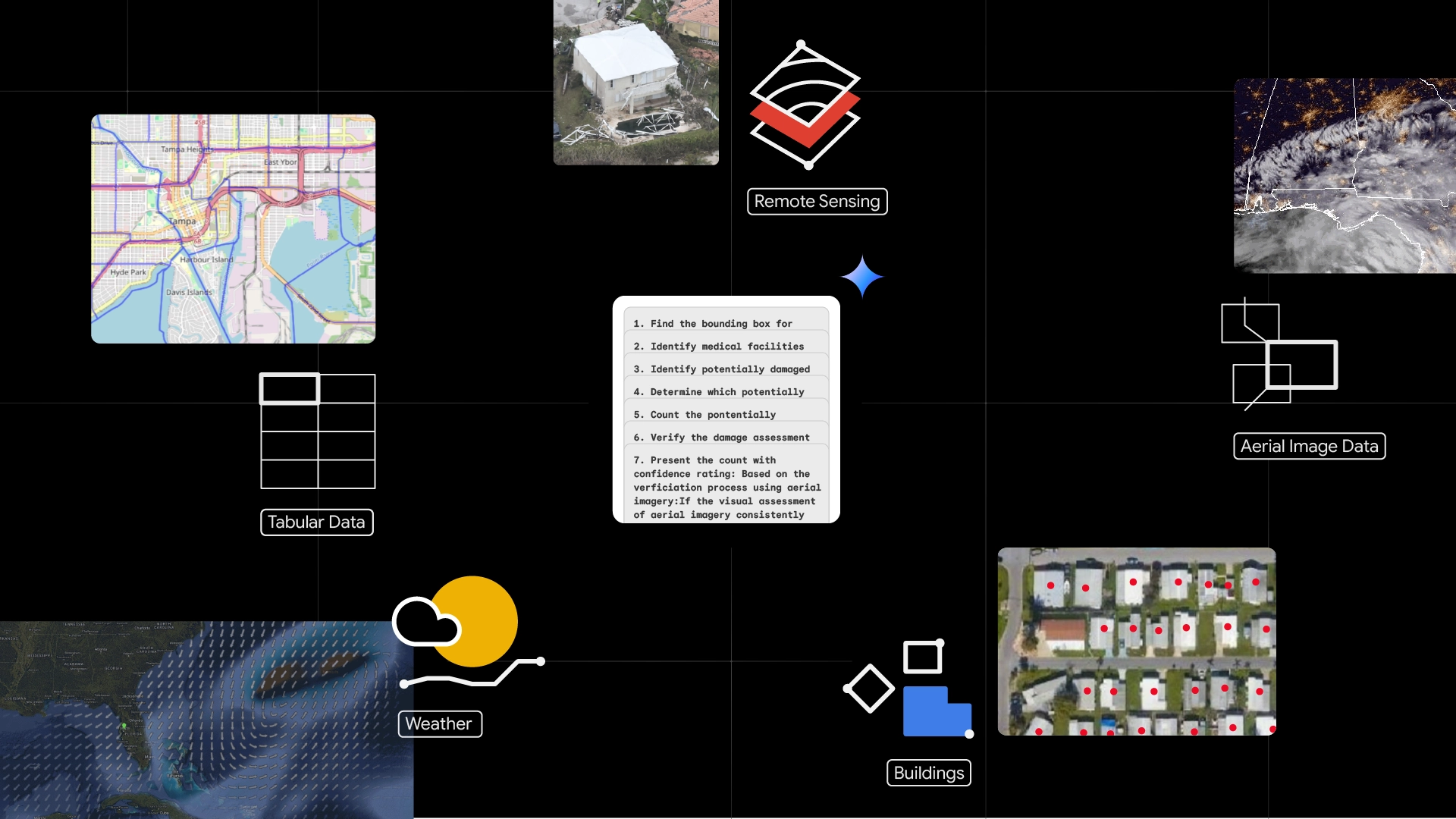

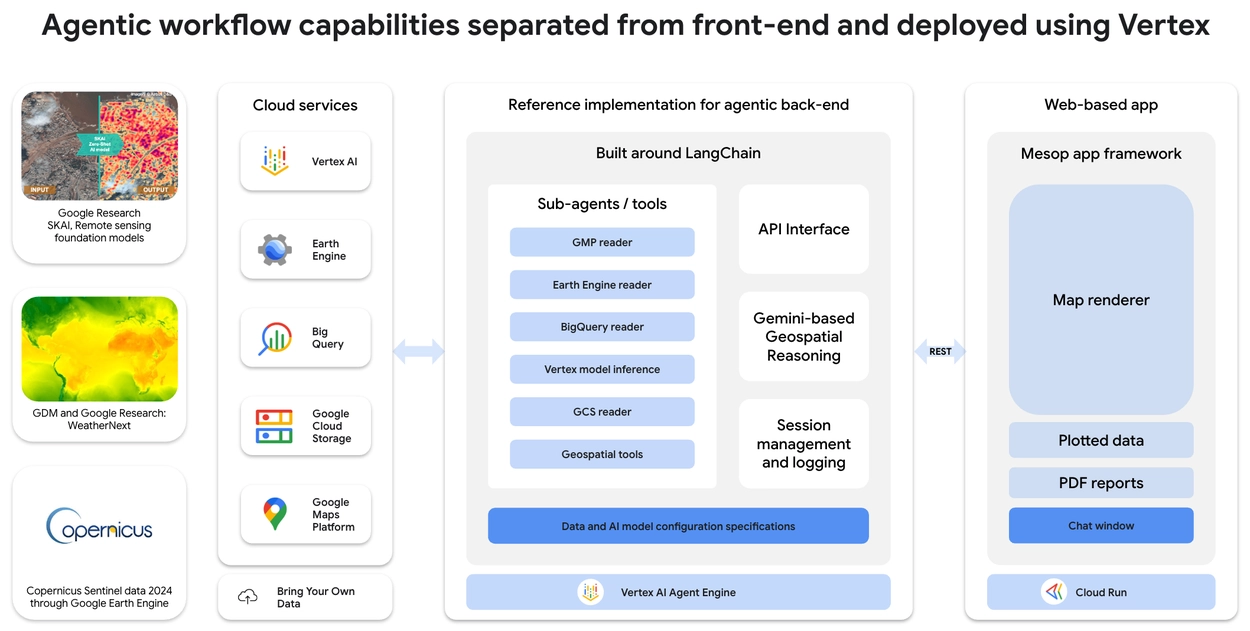

🤖 那么 Geospatial Reasoning 是怎么工作的?

这是一个 AI 工作流系统,让不同模型联动起来,一起完成一个地理任务。比如:

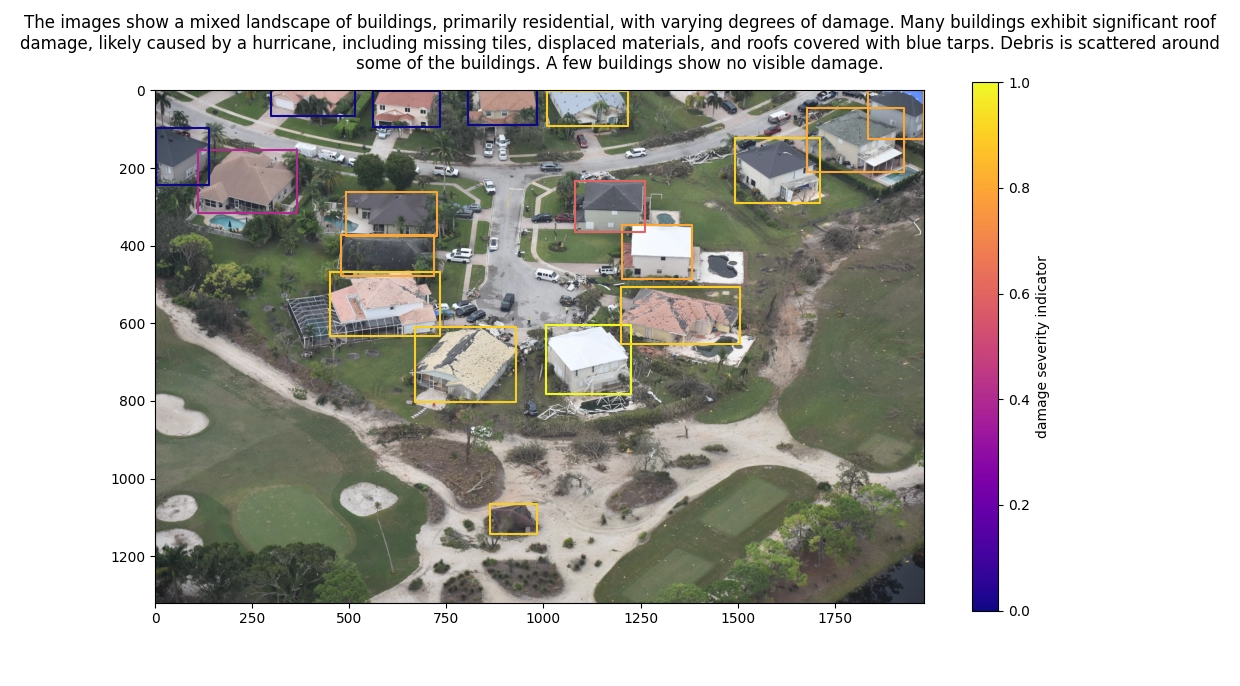

🌀 灾后场景:飓风刚过后

- 系统从 Google Earth 和 NOAA 获取“前后对比图”

- AI 模型自动检测哪些楼被毁、哪些路不能走

- 调用天气 AI 预测未来几天会不会有更多降雨

LLM(如 Gemini)会自动帮你回答问题:

- 哪些街区损毁最严重?

- 房屋损失值多少钱?

- 应该先救哪儿?

结果是一张可交互地图 + 报告 + 数据表,不是静态图片,而是活的 AI 洞察!

🧪 这个系统里都用到什么?

- 📦 Earth Engine → 提供卫星图

- 🧠 Gemini → AI 大脑,分析、规划、回答问题

- 🛰️ 遥感模型 → 看图识别建筑和道路

- 📊 BigQuery / Maps → 查数据

- 🧩 自定义 Agent → 把所有任务像拼图一样串联自动完成

开发者可以用 Python 或界面操作,系统会自动帮你规划任务步骤。

🏗️ 谁在用?有什么用?

例子(图像+问答流程)

- 用户问:“哪些建筑在这次洪水中被破坏?”

- 系统自动拉图 → 调用模型找建筑 → 识别损坏程度

- Gemini AI 总结回答,并给出地图和报告

是不是就像一个会看地图、会分析、会给建议的超级地理助理?

🔮 它未来还能做什么?

- 分析城市增长趋势、房地产、人口密度变化

- 协助环境保护、林火监测、土地使用规划

- 与你自家数据结合(比如人口普查、物业资料)实现本地 AI 辅助决策