Runway 推出第四代视觉生成模型:Runway Gen-4 ,它在保真度(fidelity)、动态运动(dynamic motion)和可控性(controllability)方面较前代Gen-3 Alpha有了显著提升。

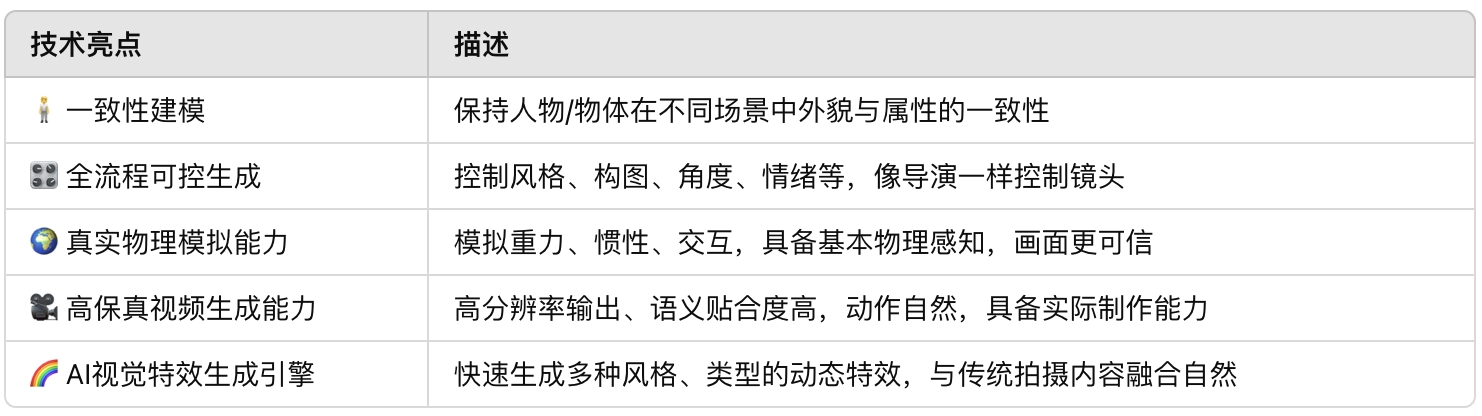

Runway Gen-4 可实现:

- 角色、场景、物体的一致性生成

- 风格、氛围和镜头语言的可控性

- 支持从多角度、多位置重建世界元素

- 无需微调或额外训练即可控制创作风格

- 模拟真实世界物理、空间与角色的能力。

它标志着向「一致性、可控性、真实感」更进一步的图像与视频生成范式的演进。

核心功能与特点详解

1️⃣ 一致性生成(Consistent Generation)

📌 角色一致性:Runway Gen-4 可让您在无数种光照条件、位置和处理方式下生成一致的角色。只需一张角色参考图像即可。

- 只需一张角色图片,即可自动在多个镜头和环境中维持该角色的面貌、姿态与风格;

- 支持多种光照、角度、表现手法;

- 应用于电影、动画、连续内容创作极为便捷。

📌 物体与场景一致性:将任何物体或主题放置在您需要的任何位置或条件下。无论您是为长篇叙事内容制作场景还是生成产品摄影,Runway Gen-4 都可以轻松实现跨环境的一致生成。

- 可以反复生成同一个物体在不同场景中的呈现(如某产品在各种背景中);

- 例如:一张杯子的图,可以生成它在厨房、草地、办公室等环境中的版本。

2️⃣ 多角度视图生成(Multi-view Scene Rendering)

要制作场景,只需提供拍摄对象的参考图像并描述拍摄的构图即可。Runway Gen-4 将完成其余工作。

- 支持用自然语言或图片描述一个场景,模型可以自动生成多个角度的画面;

非常适合:

- 镜头设计(电影拍摄预览)、

- 虚拟现实场景制作、

- 动画分镜草图生成等。

3️⃣ 风格化与电影感控制(Stylized Cinematography)

- 支持用户设定整体风格、氛围、色调;

- 模型将自动保持每一帧画面的电影感一致性;

- 例如:你可以设定为「蒸汽朋克风」或「90年代美剧风格」,模型会全程保持。

4️⃣ 生产级视频生成能力(Production-ready Video Generation)

生成的视频不仅清晰、动态自然,还能保持:

- 主题、角色、动作、背景的连续一致;

语言提示的高忠实度响应(Prompt Adherence)

- Gen-4能更准确地解析复杂的文字指令,避免生成与用户意图偏离的内容。例如,用户输入“一只猫在月光下的屋顶上跳跃”,Gen-4不会错误生成“狗”或“白天场景”。

- 优秀的世界理解能力(World Understanding)。

这意味着它适合真正的内容制作,而不只是AI爱好者玩具。

5️⃣ 物理模拟(Physics Awareness)

Gen-4被Runway称为具备“一流的世界理解能力”。这意味着模型不仅能生成静态图像,还能模拟现实世界的物理规律和环境动态。

模型初步具备对现实物理世界的理解能力:

- 动作受重力影响;

- 镜头空间有透视感;

- 人与物之间存在自然交互。

- 举例:如果用户要求生成“一个球从桌子边缘滚落”,Gen-4能正确模拟重力、滚动轨迹和落地效果,而非简单生成静态画面。

- 这种能力使其在生成复杂场景(如人群互动、自然灾害)时表现出色。

这使得生成的图像和视频更加逼真、可信。

6️⃣ GVFX(Generative Visual Effects)视觉特效引擎

- 可以与真人拍摄、动画、传统VFX内容无缝融合;

- 支持快速生成各种风格或效果的片段,适用于广告、MV、科幻片等;

- 让创作者更快速构建复杂特效内容。

长篇叙事能力

Runway 展示了数部由 Gen-4 完成的短片,涵盖从动画到写实特效场景的各种类型,全部内容由AI生成。这些作品展示了模型在长篇叙事中的潜力:

目前 Gen-4 已对付费及企业用户开放,并将持续推出更多功能。

《孤独的小火焰》,全片由 Gen-4 制作完成。

《纽约是一座动物园》展示了 Gen-4 的惊人视觉特效能力,把超现实的动物放进了纽约的电影场景中。每个片段都是通过将真实动物图像和纽约照片结合后,再使用 Gen-4 的参考功能生成场景中的具体动作。

《牛群》是一部短片,讲述一个年轻人在夜间被牛群追赶的故事。通过少量图像参考,Gen-4 构建了人物与朦胧的牛群田野场景,再借助 Act-One 完成故事叙述。

《寻找之旅》是一部短动画,讲述一群探险者寻找神秘花朵的过程。影片完全由 Gen-4 制作,不到一周完成。