阿里巴巴推出 QVQ-Max 视觉推理模型QwQ-Max-Preview ,它不仅能够“看懂”图片和视频里的内容,还能结合这些信息进行分析、推理,甚至给出解决方案。

从数学题到生活小问题,从编程代码到艺术创作,QVQ-Max 都表现出了不俗的能力。

QwQ-Max 在深度推理、数学、编程、通用领域任务以及与代理(Agent)相关工作流中的卓越表现。QwQ-Max-Preview 是即将推出的完整版 QwQ-Max 的前瞻版本,最终将以 Apache 2.0 许可开源。

✅ 本质特征:

- 属于多模态大模型(Multimodal Large Language Model),融合**视觉(图像/视频)与语言(文本)**信息。

- 强调“看图思考”:不仅能识别图像,还能进行分析、推理,解决现实问题。

- 支持图像理解 + 语言生成 + 创意生成,服务于学习、工作、生活等多领域应用。

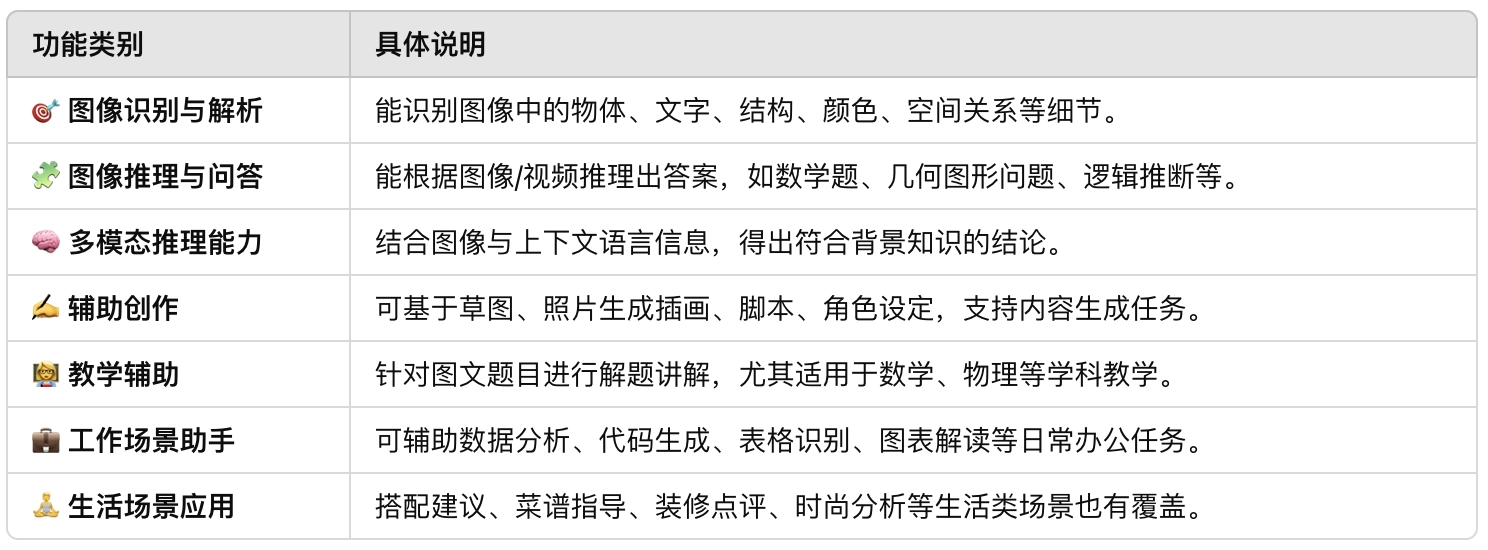

主要功能

QVQ-Max的能力可以总结为三个方面:细致观察、深入推理和灵活应用。

1. 精细观察(Detailed Observation)

- 能精准识别图像中的各类信息:对象、文字标签、微小细节。

- 适用于从复杂图表到日常照片的理解。

2. 深度推理(Deep Reasoning)

- 结合视觉内容与背景知识进行推理判断。

例子:

- 几何题目中,通过图示推导出正确答案;

- 视频片段中预测后续可能情节。

3. 灵活应用(Flexible Application)

- 创意任务:设计插画、生成短视频脚本、角色扮演内容。

辅助创作:从草图生成完整作品;对照片进行点评、生成趣味解读等。

应用场景与 Demo

- 办公助手

- 辅助进行数据分析、信息整理、代码生成。

- 学习辅助

- 解决数学、物理等学科中的图文结合难题;

- 提供直观讲解,提升学习效率。

- 生活助手

- 如穿搭建议(基于衣橱照片)、菜谱图像烹饪指导等。

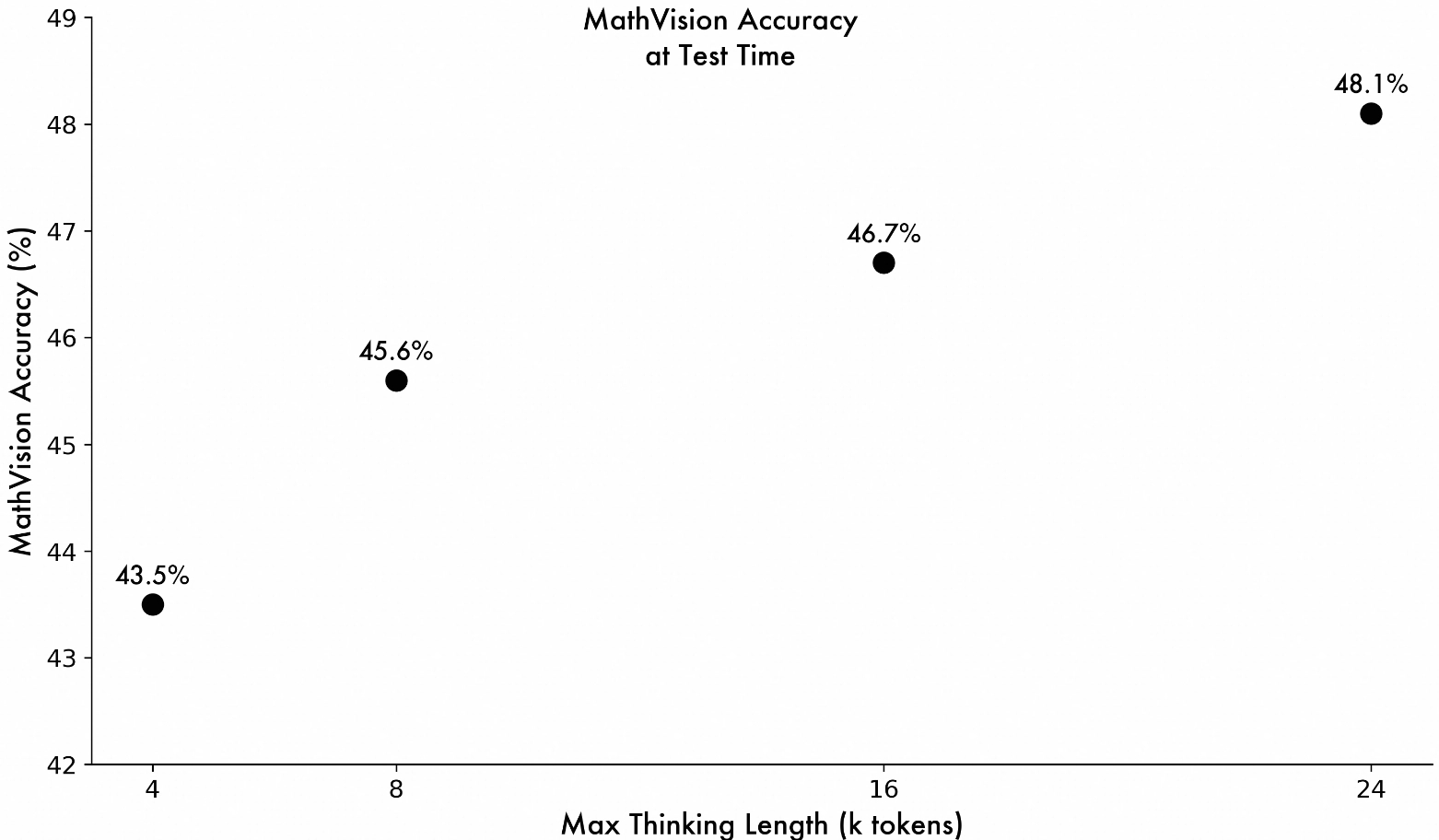

数学推理

视频理解

口译手相读数

多图识别

通过观看视频学习编程

未来发展方向

更准确的视觉识别

- 借助 Grounding 技术进一步提高图像识别的准确性。

视觉代理能力(Visual Agent)

- 完成多步任务:如操控手机、电脑,甚至玩游戏。

更自然的人机交互

- 不仅限于文本互动,未来将支持工具调用、视觉生成等多模态交互。