近日,人工智能领域再度掀起波澜,月之暗面(Moonshot)宣布开源新版优化器 Muon,成功将计算效率提升至传统 AdamW 的两倍。这个新优化器的推出恰逢 DeepSeek 即将连续开源多个代码库,引发了业内的高度关注和讨论。

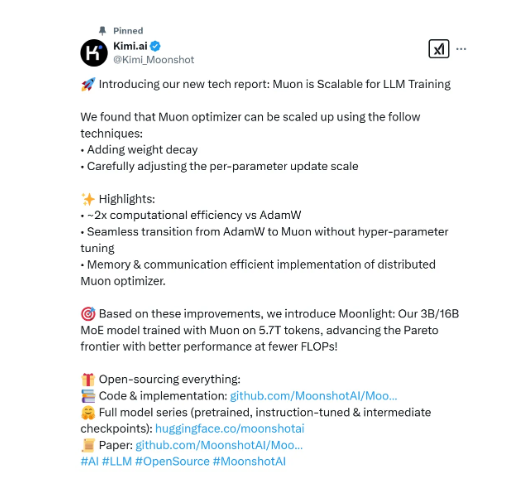

Muon 优化器最初由 OpenAI 的研究者 Keller Jordan 等人在2024年提出,针对小规模模型训练时表现优异。然而,随着模型规模的扩大,原始 Muon 在性能提升上遭遇瓶颈。为此,月之暗面团队进行了深入的技术改进,主要包括添加权重衰减和一致的均方根(RMS)更新,以支持在大规模训练中应用 Muon,无需再进行超参数调整。

新的 Muon 优化器已被应用于最新推出的 Moonlight 模型,这是一种拥有3B/16B 参数的混合专家(MoE)模型,在经过5.7万亿 tokens 的训练后,性能显著提升,成为当前的 “帕累托前沿”。这一成果意味着,在相同的训练预算下,Moonlight 模型在所有性能指标上均超越其他模型。

月之暗面还开源了 Muon 的实现代码,并发布了相应的预训练和中间检查点,为研究人员的后续研究提供了宝贵资源。研究表明,Muon 优化器在训练过程中所需的 FLOPs 仅为 AdamW 的52%,这进一步验证了其在大规模语言模型训练中的高效性。

月之暗面的 Muon 优化器不仅在性能上超越了传统的优化器,而且通过开源的形式为整个 AI 领域的发展注入了新的活力。随着越来越多的研究者和开发者的参与,这一优化器有望推动人工智能技术的进一步进步。

论文地址:https://github.com/MoonshotAI/Moonlight/blob/master/Moonlight.pdf