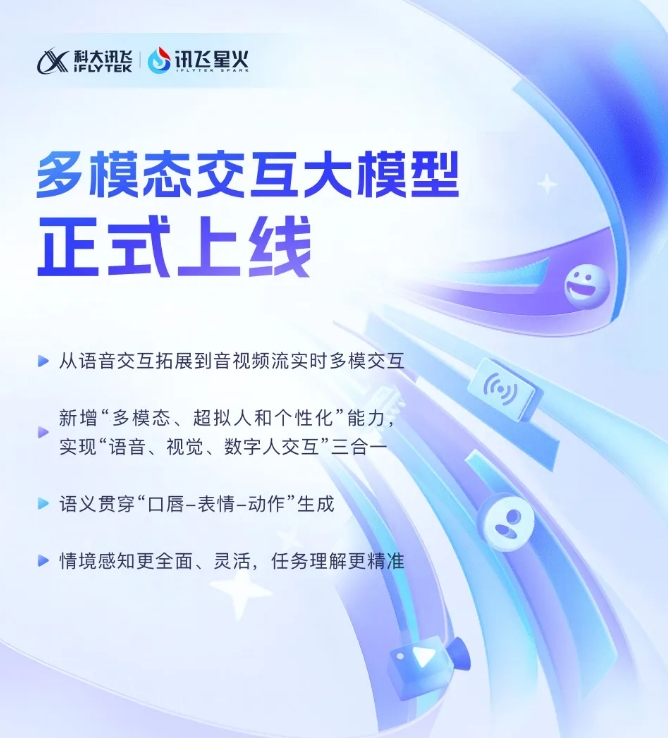

科大讯飞公司近日宣布,其最新研发的讯飞星火多模态交互大模型正式投入运营。这一技术突破标志着科大讯飞从单一的语音交互技术拓展到音视频流实时多模态交互的新阶段。新模型集成了语音、视觉和数字人交互功能,用户可通过一键调用,实现三者的无缝结合。

讯飞星火多模态交互大模型的推出,首次引入了超拟人数字人技术,该技术能够使数字人的躯干和四肢动作与语音内容精准匹配,快速生成表情和动作,极大提升了AI的生动性和真实感。通过整合文本、语音和表情,新模型能够实现跨模态的语义一致性,让情感表达更加真实连贯。

此外,讯飞星火支持超拟人极速交互技术,利用统一神经网络直接实现语音到语音的端到端建模,使得响应速度更快、更流畅。该技术能够敏锐感知情绪变化,并根据指令自由调整声音的节奏、大小和人设,提供更为个性化的交互体验。

在多模态视觉交互方面,讯飞星火能够“听懂世界”“认清万物”,全面感知具体背景场景、物流状态等信息,使得对任务的理解更加精准。通过综合语音、手势、行为、情绪等多种信息,模型能够作出合适的回复,为用户提供更为丰富和精准的交互体验。

多模态交互大模型SDK:https://www.xfyun.cn/solutions/Multimodel