声明:本文来自于微信公众号 AIGC开放社区(ID:AIGCOPEN),作者:AIGC开放社区,授权Soraor转载发布。

6月13日,知名3D建模平台LumaAI发布最新文生视频模型Dream Machine,向所有用户免费开放使用。

Dream Machine除了支持文本之外,还可使用图片作为引导来生成视频,其生成的视频质量、动作一致性、色彩、光影、饱和度、运镜等方面,可以媲美OpenAI的Sora。

Dream Machine的另外一个技术特点是支持物理模拟,这意味着生成的视频更能体现出物理世界的特点,包括重力下落、碰撞、光影变化等。

Dream Machine生成的视频

为什么物理模拟,对文生视频很重要

目前,国内外文生视频赛道都主打“物理模拟”这个技术特点,可以确保生成的视频不仅看起来非常真实,并在时间和空间上保持连贯性、一致性。

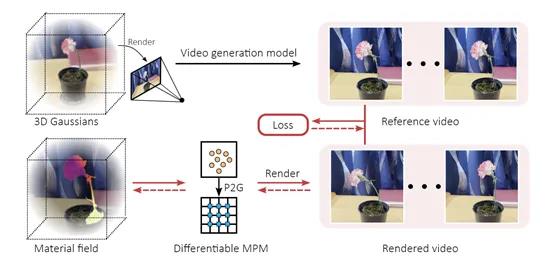

麻省理工学院、斯坦福大学、哥伦比亚大学和康奈尔大学联合开源的3D交互视频模型就深度介绍过该技术。

动态模拟与物理一致性是大模型生成高质量视频的核心技术之一,要想实现这两点,就需要理解和模拟现实世界中的物理规律。

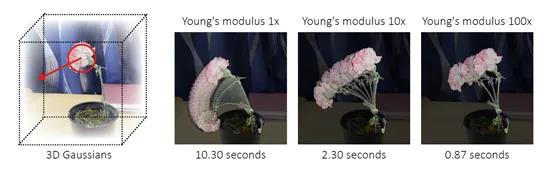

动态模拟指的是视频生成过程中对物体和场景的运动进行精确的模拟。在一个视频片段中,物体的运动轨迹、速度和加速度需要符合现实世界的物理定律。

例如,当一盆花在风中左右摇摆时,视频中的每一帧都必须展示花盆和花朵按照风力的作用进行摆动,花盆由于重力和风力的交互作用而略微倾斜,然后在风力减弱时逐渐恢复到垂直状态。

这种模拟需要对物体的运动状态进行连续的计算和更新,确保视频前后帧之间的连贯性。

物理一致性是视频中的物体和场景遵循现实世界的物理规律,包括重力、碰撞、摩擦力、空气阻力等。

这不仅仅是对单个物体运动的模拟,还包括物体之间的相互作用。例如,在生成两辆车相撞的场景时,模型需要模拟碰撞时的力和反作用力,考虑车体的变形和碎片飞散的方向和速度。这种物理一致性使得生成的视频更加逼真和可信。

所以,为了实现动态模拟与物理一致性,文生视频模型通常会使用大量包含了现实世界中物体运动和相互作用的视频数据和互作用实例。

通过学习这些数据,模型可以捕捉到物体运动的规律和相互作用的模式,并将其应用到新的视频生成过程中。

此外,有的视频模型可能还会加入物理引擎,将场景中的物体和环境参数输入到模拟器中,然后通过数值计算来模拟这些物体在受力后的运动和变化。

例如,当生成一个描述风吹动树叶的视频时,物理模拟引擎会计算风力对树叶的影响,包括风的速度、方向对树叶的摆动和飘落的影响。可以让大模型生成的视频不仅在视觉上逼真,而且在物理行为上也是一致的。

Dream Machine生成案例展示

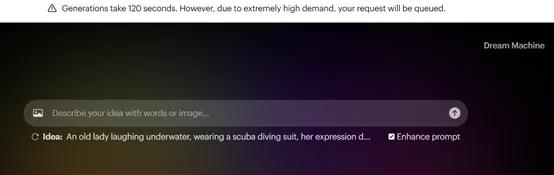

由于Dream Machine免费开放使用,使用的人非常非常多,目前生成的效率比较差。

官方宣称生成一个视频是120秒左右,实际是几分钟甚至10分钟左右才能生成一个视频,效果还是相当好的。

那就先为大家展示一下其他人已经生成好的视频作品。

例如,一个真实的废墟场景拍摄镜头。这个生成的视频有点像虚幻引擎5游戏里的场景,已经非常真实了。

一辆飞奔在高速公路上的跑车。虽然这个视频只有5秒钟,但是它的运镜、场景切换浮动很大,而且连贯、丝滑,这比Gen-2、Pika等同类产品生成的效果更好。

下面这个是图片生成视频的案例,本身是一张静止的图片,加上图片和文本描述轻松就动起来了,可以看到运动性的幅度依然很大。

也有一些接受过内测邀请的,通过Dream Machine做了不少微电影。例如,下面这个做的《Tales of the Other Side》电影预告。

制作的人类在未来与机器人关系的微电影。

一部关于怪物的卡通动漫视频

今年年初OpenAI发布的Sora确实很惊艳,但将近4个月的时间还在封闭测试中,无疑极大打击了用户的热情。

而国内快手发布的“可灵”和今天最新的Dream Machine已经全面开放使用,并且在生成的视频质量方面不输Sora,文生视频赛道的竞争格局将会像文本一样更加激烈。

免费体验地址:https://lumalabs.ai/dream-machine/creations